Google-Agent: El Cambio en el Acceso Web que Afecta a los Desarrollado

Google-Agent ignora robots.txt, según la documentación oficial. Este agente impulsado por IA representa un cambio fundamental en cómo Google interactúa con la w

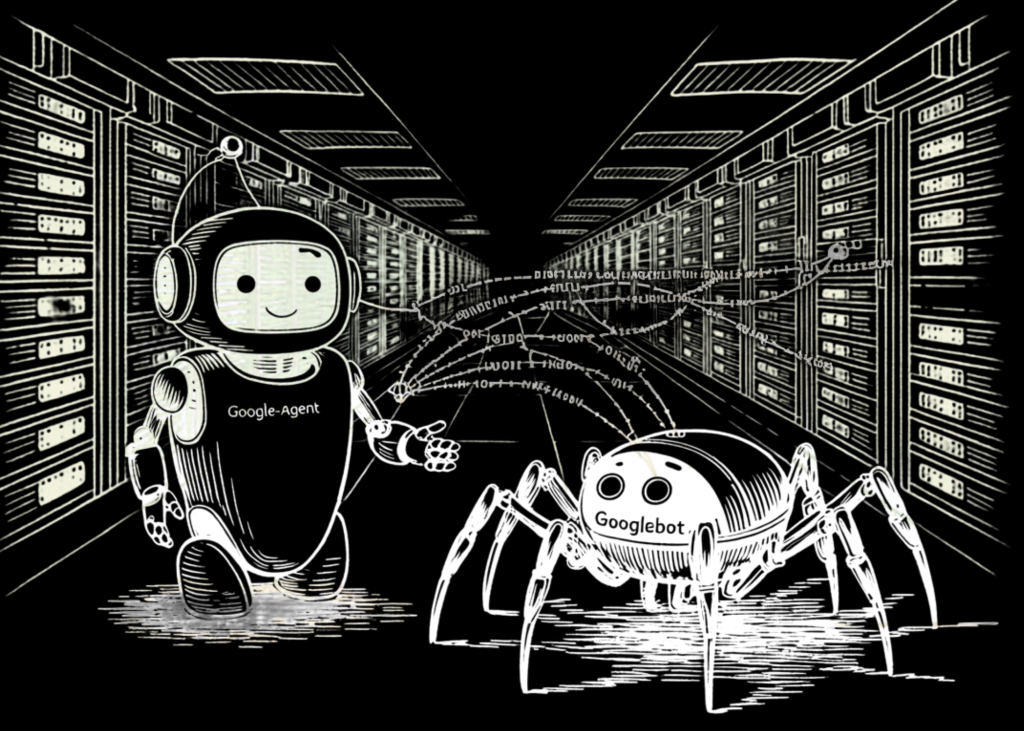

Un nuevo agente de Google aparece en los registros del servidor. Los desarrolladores deben entenderlo para distinguir entre indexadores automáticos y solicitudes en tiempo real iniciadas por usuarios.

El Panorama General Google-Agent es una entidad técnica que opera bajo un conjunto diferente de reglas y protocolos. A diferencia de los rastreadores autónomos que han definido la web durante décadas, este agente solo actúa cuando un usuario realiza una acción específica.

La distinción fundamental es entre rastreadores y recuperadores. Los rastreadores autónomos como Googlebot descubren e indexan páginas según un horario determinado por los algoritmos de Google. Los recuperadores activados por usuarios, como Google-Agent, son utilizados por productos de IA de Google para obtener contenido de la web en respuesta a una solicitud directa del usuario.

“Google-Agent ignora robots.txt porque las recuperaciones son iniciadas por usuarios humanos que solicitan interactuar con contenido específico.”

Por Qué Importa Para los ingenieros de software que gestionan infraestructura web, el auge de Google-Agent cambia el enfoque de los 'presupuestos de rastreo' centrados en SEO a la gestión de solicitudes en tiempo real. La observabilidad se vuelve crítica: el análisis moderno de registros debe tratar a Google-Agent como una solicitud legítima impulsada por usuarios.

Si su firewall de aplicaciones web o software de limitación de velocidad trata a todos los 'bots' por igual, puede bloquear inadvertidamente a los usuarios que utilizan herramientas de IA de Google para interactuar con su sitio.

La privacidad y el acceso presentan desafíos particulares. Dado que robots.txt no gobierna a Google-Agent, los desarrolladores no pueden confiar en él para ocultar datos sensibles o no públicos de los recuperadores de IA. El control de acceso para estos recuperadores debe manejarse mediante autenticación estándar o permisos del lado del servidor, tal como lo haría para un visitante humano.

La carga de infraestructura también cambia. Debido a que estas solicitudes son 'explosivas' y están vinculadas al uso humano, el volumen de tráfico de Google-Agent escalará con la popularidad de su contenido entre los usuarios de IA, en lugar de con la frecuencia de los ciclos de indexación de Google.

Tags