IA: El cambio de Chroma en la búsqueda de documentos financieros

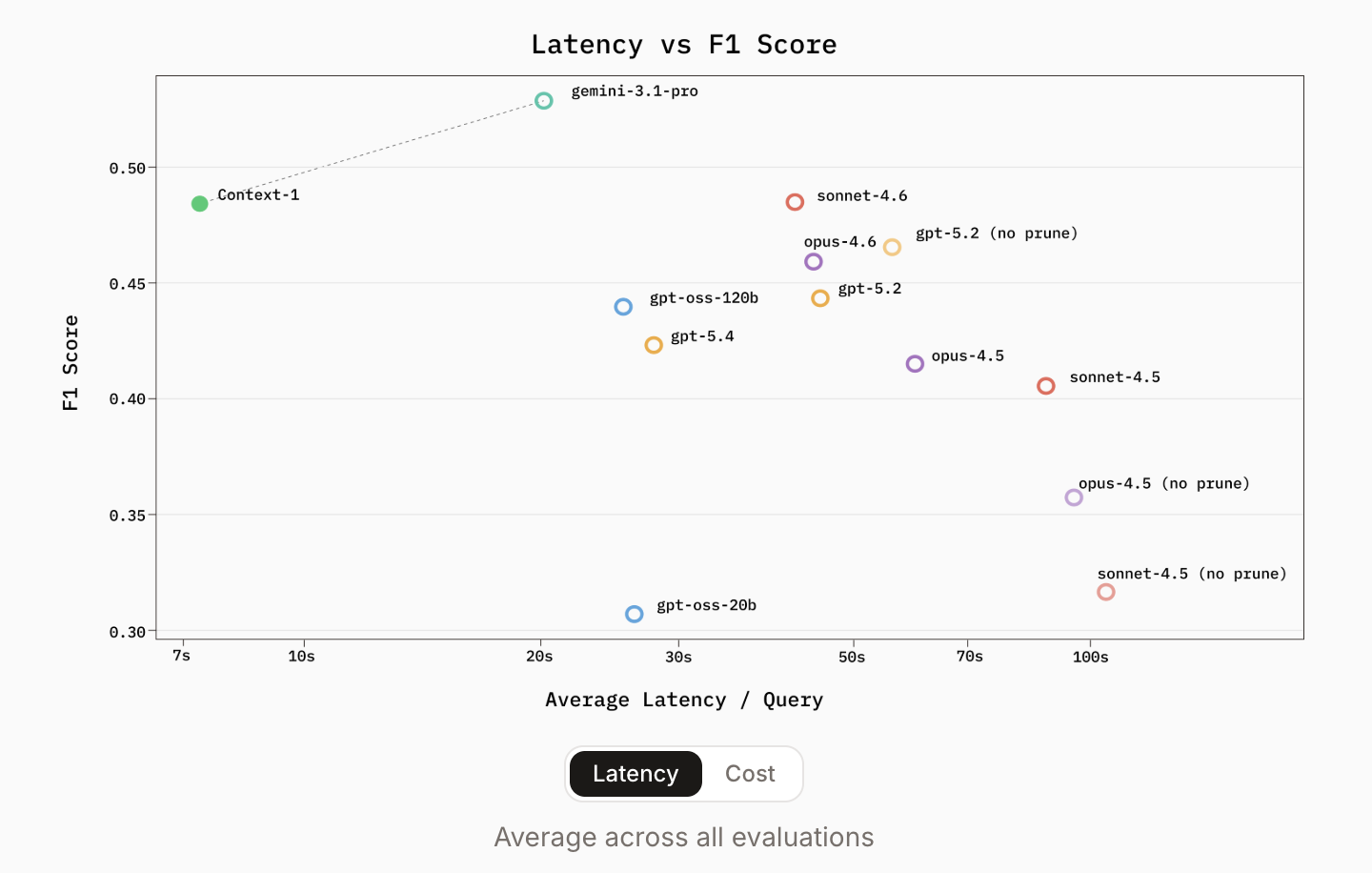

Chroma lanza Context-1, un modelo de 20B parámetros que resuelve búsquedas complejas en documentos SEC con precisión del 94%. El futuro de la investigación fina

Los modelos de IA se ahogan en documentos. Chroma ofrece una solución quirúrgica.

El panorama general Los sistemas de IA actuales tratan la ventana de contexto como un martillo. Meten un millón de tokens y esperan lo mejor. El resultado: latencia alta, costos astronómicos y razonamiento perdido en el medio. Chroma, conocida por su base de datos vectorial de código abierto, toma un camino diferente. Su nuevo modelo Context-1 actúa como un subagente especializado en búsqueda. No intenta ser un motor de razonamiento general. Es un explorador optimizado para una tarea: encontrar los documentos correctos para consultas complejas y pasarlos a un modelo frontera para la respuesta final.

“Un modelo de 20B parámetros puede ahora navegar documentos SEC con la precisión de modelos mucho más grandes.”

Por qué importa La arquitectura es el cambio más importante. Context-1 desacopla la búsqueda de la generación. En un pipeline RAG tradicional, el desarrollador gestiona la lógica de recuperación. Con Context-1, esa responsabilidad se traslada al modelo mismo. Opera dentro de un arnés de agente que le permite interactuar con herramientas como búsqueda híbrida (BM25 + búsqueda densa), regex y lectura de documentos.

La innovación técnica más significativa es el Contexto de Autoedición. Mientras un agente recopila información a lo largo de múltiples turnos, su ventana de contexto se llena de documentos, muchos redundantes o irrelevantes. Los modelos generales eventualmente se ahogan en este ruido. Context-1, sin embargo, ha sido entrenado con una precisión de poda del 94%. A mitad de la búsqueda, el modelo revisa su contexto acumulado y ejecuta proactivamente un comando para descartar pasajes irrelevantes.

Esta poda de límite suave mantiene la ventana de contexto delgada, liberando capacidad para una exploración más profunda. Permite que un modelo especializado de 20B parámetros mantenga una alta calidad de recuperación dentro de un contexto limitado de 32k, incluso al navegar conjuntos de datos que normalmente requerirían ventanas mucho más grandes.

Tags